Acerca da dependência tecnológica, modelos abertos e a possibilidade de uma revolução silenciosa contra os novos centros de poder.

Há cinquenta e dois anos, por volta das 0h20 de 25 de Abril de 1974, a Rádio Renascença transmitiu a canção Grândola, Vila Morena como uma das senhas da revolução, num contexto de ruptura com o Estado Novo e com a guerra colonial.

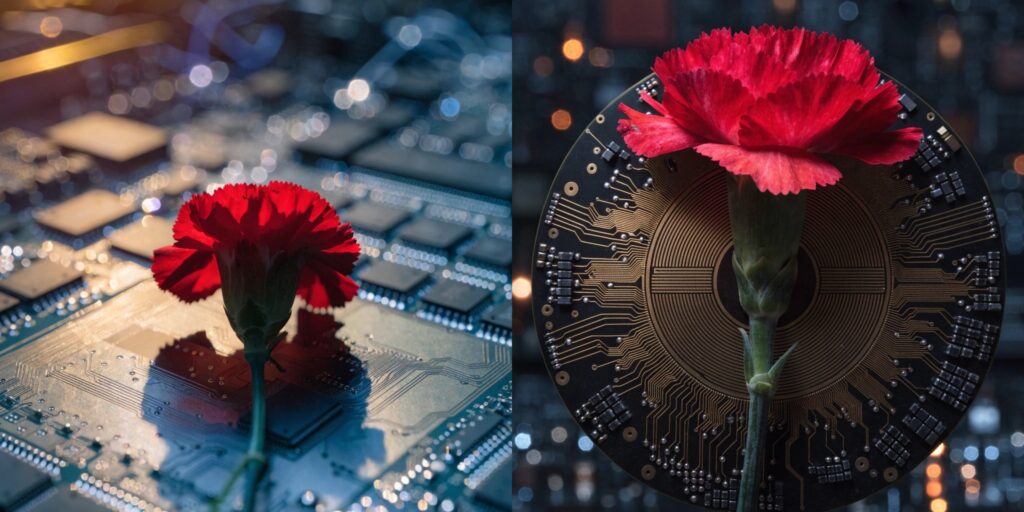

A imagem serve aqui menos como analogia histórica perfeita do que como ponto de partida para uma pergunta contemporânea: quem controla as infraestruturas tecnológicas com que se escreve, decide, pesquisa e raciocina?

O novo Estado Novo é privado, americano e roda em GPUs

Em 2026, o mercado ocidental de IA generativa de uso generalista continua fortemente concentrado em torno de um pequeno número de atores, entre os quais OpenAI, Google, Anthropic e Meta, apoiados direta ou indiretamente por infraestruturas de computação dominadas por hyperscalers como Microsoft Azure, Google Cloud e Amazon Web Services.

O ponto central não está em presumir má-fé desses atores, mas em reconhecer que a dependência tecnológica e económica de um pequeno grupo de fornecedores cria fragilidades operacionais, comerciais e regulatórias.

Essa dependência paga-se em várias moedas.

Paga-se em dados, porque mesmo quando um fornecedor promete não reutilizar conteúdos para treino, continua normalmente a existir tratamento de dados para prestação do serviço, segurança, registo e monitorização.

Paga-se em soberania digital, porque o recurso a modelos alojados fora da União Europeia pode desencadear problemas de transferência internacional de dados, avaliação de risco e conformidade com o RGPD.

Paga-se também em dependência operacional, porque alterações de preço, política de acesso, termos contratuais ou moderação podem alterar de um dia para o outro ferramentas que passaram a integrar fluxos de trabalho críticos.

RGPD e segredo profissional

Para profissões que tratam informação sensível e sigilosa, como a advocacia, a prudência não é apenas técnica; é jurídica e consiste numa obrigação.

A inserção de contratos, peças processuais, pareceres ou outros documentos confidenciais em serviços de IA de terceiros pode envolver tratamento de dados pessoais, circulação transfronteiriça de informação e riscos acrescidos para o segredo profissional, exigindo base de licitude adequada, avaliação do fornecedor, análise de transferências internacionais e, quando aplicável, instrumentos como cláusulas contratuais-tipo e medidas suplementares.

Por essa razão, a escolha da arquitetura técnica não é neutra. Soluções locais ou implantadas em infraestrutura europeia controlada podem reduzir exposição a riscos derivados de obrigações regulatórias e facilitar governação documental, auditoria e minimização de dados, embora não eliminem por si só todas as obrigações de conformidade.

A insurgência dos modelos abertos

Existe, entretanto, uma alternativa em consolidação. Famílias como Llama da Meta, Mistral da francesa Mistral AI e Qwen disponibilizam modelos com pesos abertos (open-weight), e várias iniciativas adicionais publicam modelos sob licenças (como Apache 2.0) mais permissivas ou mais próximas da noção clássica de open-source.

Esta distinção é relevante: nem todo modelo “aberto” é open-source em sentido estrito, mas a disponibilização de pesos já permite níveis de portabilidade, auditoria e controlo operacional inexistentes em sistemas totalmente fechados.

Em muitas tarefas práticas de escritório jurídico e análise documental, a distância entre bons modelos abertos e sistemas proprietários de topo tornou-se significativamente menor. Para resumir documentos, comparar versões, extrair informação estruturada, redigir minutas ou apoiar pesquisa, modelos abertos bem afinados podem ser suficientes, sobretudo quando a prioridade é controlar o ambiente de execução e reduzir a exposição de dados.

Em certos contextos, podem até ser preferíveis precisamente por serem mais previsíveis do ponto de vista de implantação e governação e permitir controlo, por vezes granular, sobre o ambiente e o modelo.

O que o AI Act muda

O Regulamento (UE) 2024/1689, conhecido como AI Act, estabelece regras harmonizadas em matéria de inteligência artificial na União Europeia e assenta numa aplicação faseada das obrigações. O regulamento reforça exigências de transparência, governação, documentação e supervisão humana, em especial para sistemas de maior risco e para modelos de IA de propósito geral em certos contextos.

Neste enquadramento, sistemas com maior auditabilidade e controlo técnico tendem a encaixar melhor em estratégias de conformidade, embora o regime jurídico aplicável dependa sempre do caso de uso concreto, do papel do responsável pela implantação e do nível de risco envolvido.

A abertura técnica não dispensa deveres legais, mas pode facilitar demonstração de diligência, gestão e controlo de risco e capacidade de resposta a exigências regulatórias.

Nem romantismo nem rendição

Seria enganador concluir que os modelos abertos já substituem integralmente os sistemas fechados em todas as frentes. Fontes públicas e investigação recente continuam a mostrar que os modelos proprietários (fechados) líderes mantêm vantagem em várias capacidades de fronteira, incluindo raciocínio complexo, certas formas de multimodalidade avançada e alguns trabalhos de interpretabilidade e segurança de ponta que os modelos de peso aberto, pelo menos por ora, não conseguem assegurar.

A Anthropic, por exemplo, permanece particularmente relevante na investigação sobre segurança e interpretabilidade, com equipas e publicações dedicadas à análise interna de modelos e foco na IA humana e responsável. Reconhecer essa liderança em áreas específicas não contradiz o argumento central: o problema estrutural continua a ser a dependência excessiva de poucos fornecedores para funções cada vez mais críticas.

A estratégia mais realista

A resposta mais sensata não parece ser nem a rejeição total dos modelos fechados nem a sua adoção acrítica. Uma estratégia de “carteira diversificada” continua a ser a mais prudente: reservar modelos fechados para tarefas que exijam capacidades de fronteira; privilegiar modelos locais, open-weight ou implantados em infraestrutura europeia para fluxos com dados sensíveis; e preservar sempre capacidade de substituição tecnológica.

Essa opção é simultaneamente prática e política. Apoiar o desenvolvimento de modelos europeus mais abertos, auditáveis e competitivos não corresponde apenas a uma preferência industrial; corresponde também a uma política de soberania digital e de redução de dependências estratégicas.

O ‘cravo digital’

A metáfora do cravo continua útil desde que não seja usada em excesso. A questão não é militarizar o discurso sobre tecnologia, mas recordar que infraestruturas críticas de conhecimento não devem ficar concentradas sem escrutínio em meia dúzia de entidades privadas.

Se a liberdade política exigiu, em 1974, a rejeição de uma concentração opaca de poder, a liberdade tecnológica exige hoje utilizadores informados, reguladores exigentes e alternativas técnicas viáveis.

A IA não precisa de tanques nas avenidas. Precisa de pluralismo técnico, portabilidade, auditabilidade, responsabilidade regulatória e capacidade europeia de escolha.